CT250MX500SSD1/JPをTS-873に入れてみた記録

最初に

QNAP TS-873-4G

メモリを64GB化済

Amazon | QNAP(キューナップ) TS-873 クアッドコア2.1 GHz CPU 4GBメモリ 8ベイ DTCP-IP/DLNA対応

https://amzn.to/34uq7oC

Crucial CT250MX500SSD1/JP

Amazon | Crucial SSD 250GB 内蔵2.5インチ 7mm MX500 (9.5mmアダプター付) CT250MX500SSD1/JP

http://amzn.to/2Gm7bNc

SSDを入れてみるとどのくらいのパフォーマンスがあるのか

手元にCT250MX500SSD1/JPが2台あったので入れてみました

CT250MX500SSD1/JPについては以前の記事で紹介してますが

購入時期が違ってFWも違うので改めて計測してます

crucial MX500 CT250MX500SSD1/JPを計測 | fefcc.net

https://fefcc.net/archives/605

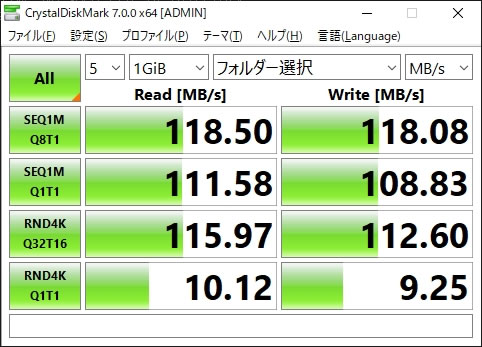

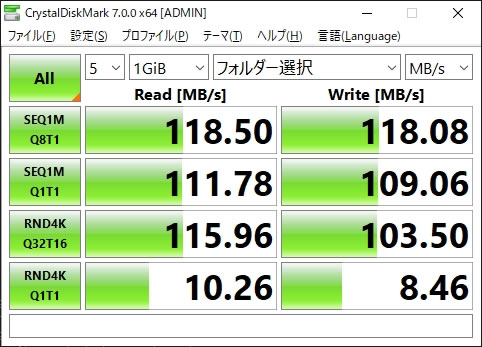

CT250MX500SSD1/JP単体で計測

NASではなくPCへ接続して直接計測

FWはM3CR023

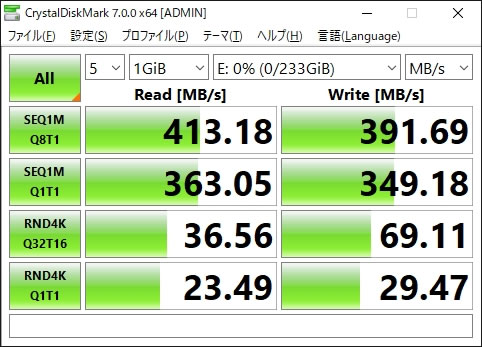

TS-873に入れて計測

QTSのバージョンは4.4.1.1117

QTS上でのCT250MX500SSD1/JPの実認識容量は232.89GB(250GB)

システムボリュームは別のディスクへ既に作成済

SSD使用時に選択できるオーバープロビジョンは使用してません

NASローカル計測の計測方法については以前の記事と同じですので

そちらをご覧ください

TS-873でのローカル速度計測 | fefcc.net

https://fefcc.net/archives/886

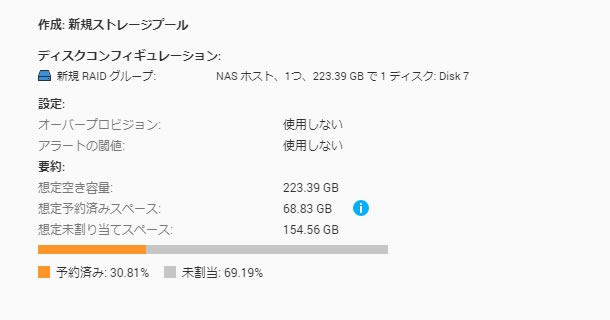

SSD1台 RAIDなし

ストレージプール作成の想定容量

想定空き容量:223.39GB

想定予約済みスペース:68.83GB

想定未割り当てスペース:154.56GB

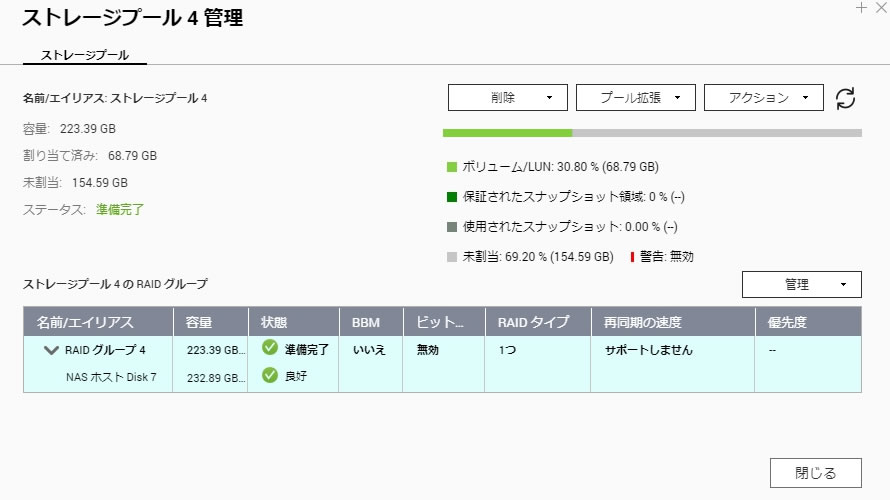

実際に構築した状態

空き容量:223.39GB

予約済みスペース:68.79GB

未割り当てスペース:154.59GB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV4_DATA/test/fio-cdm /share/CACHEDEV4_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 342.590| 292.990| | 512K | 308.992| 271.330| | 4K | 32.162| 68.804| |4KQD32| 208.003| 183.578|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV4_DATA/test/fio-cdm /share/CE_CACHEDEV4_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 302.422| 218.523| | 512K | 242.424| 165.776| | 4K | 32.806| 53.214| |4KQD32| 195.569| 181.143|

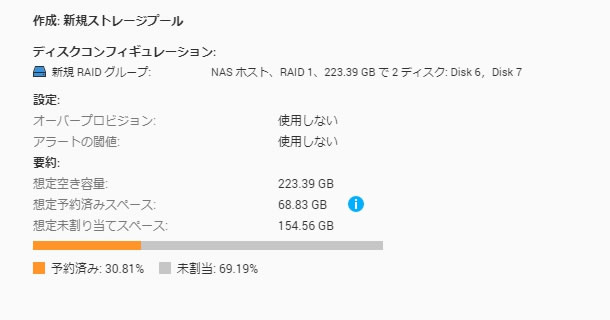

SSD2台 RAID1

ストレージプール作成の想定容量

想定空き容量:223.39GB

想定予約済みスペース:68.83GB

想定未割り当てスペース:154.56GB

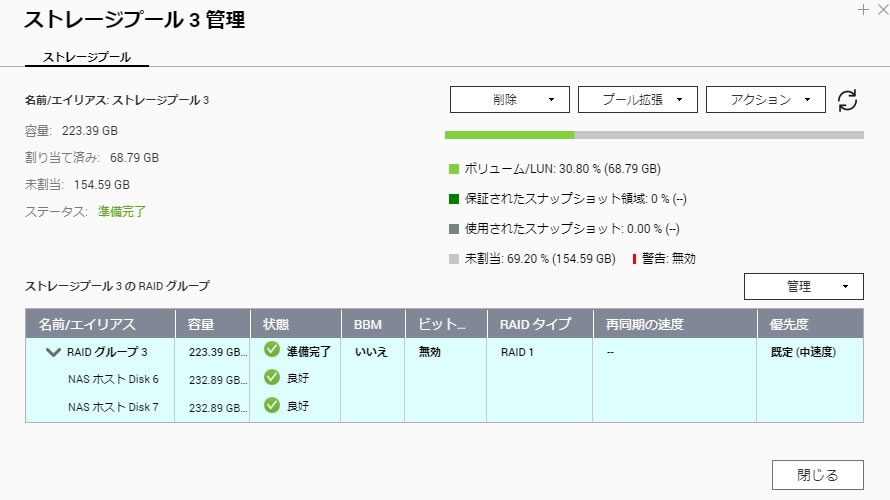

実際に構築した状態

空き容量:223.39GB

予約済みスペース:68.79GB

未割り当てスペース:154.59GB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV4_DATA/test/fio-cdm /share/CACHEDEV4_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 376.609| 285.396| | 512K | 301.798| 262.161| | 4K | 33.021| 64.639| |4KQD32| 230.112| 144.368|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV4_DATA/test/fio-cdm /share/CE_CACHEDEV4_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 319.202| 216.720| | 512K | 234.755| 166.180| | 4K | 32.782| 50.887| |4KQD32| 207.036| 148.967|

まとめ

基本的にはキャッシュ無効になって素のパフォーマンスが確認できる

ローカル計測結果を参考に見てもらえればと思います

Windowsからの計測もGbE上限値ですが一応、記録の為掲載しておきました

GbE環境の場合、通信経路がボトルネックなので

HDD・SSDともに実際のパフォーマンスにほぼ変わりはないですが

メモリが少ない等でキャッシュ溢れが多い環境であれば

素のパフォーマンスのおかげでランダムアクセスが快適になります

最後に

SSDをRAIDで使用する場合の注意点ですが

RAIDの仕組み上、全ディスクがほぼ同量の書き込み量になるので

一定の書き込み量で寿命を迎えるSSDとはどうしても相性がよくありません

(特にRAID6を選択するメリットがHDDより減る)

もちろん使い方や何年ぐらい使う予定なのか次第で

倉庫的な書き込みが少ない環境やTBWが元々多いSSDであれば全く気にする必要はなし

仮想マシン用などで書き込みが多い環境や

TBWの少ないQLC SSDを導入する場合だけ注意が必要

事前にこの問題があることを利用者がわかっていれば

ハードな使い方をする環境であっても

S.M.A.R.T.で総書き込み量を確認してTBWに到達する前に交換すれば

簡単に対処可能ですので致命的な問題ではありません

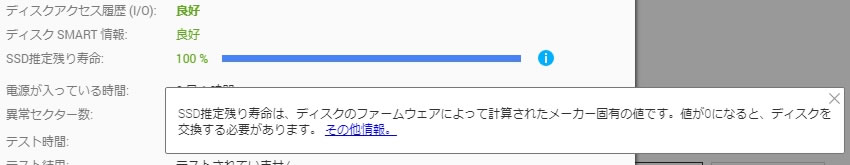

S.M.A.R.T.で「残り寿命」を提供しているSSDであれば

QNAPの場合はディスク情報にて「SSD推定残り寿命」が表示されます

その他情報のリンク先はヘルプセンターになっていて以下の説明文が表示されます

Synologyでも同様にHDD/SSD -> 健康状態に「想定寿命」として表示されています

Synologyの場合は更になる対処法として交換のタイミングを1台だけずらすことが可能な

RAID F1という選択肢がオールSSD構成のNAS向けに用意されています

RAID F1

SSDとRAID技術がもつ特異性により生じる、負荷が均一に分散することで全ドライブが同時に故障するという傾向をいかに防ぐかが大きな課題ですRAID F1 は、異なるドライブにワークロードを不均一にかけるよう特別に設計されたアルゴリズムでこの問題を軽減し、ストレージプールの耐久性を強化し、データの安全性を高めます。

RAID5をベースに1台だけ負荷を多くかけるだけなので意外とシンプル

RAID5ベースなので3台以上が必要ですが気になる方はRAID F1で検索してみてください

QNAPには今のところ似た機能はないですけどオールSSDのNASが増えてきたので

Synologyと同じく倉庫以外で利用するような上位機種に向けて

何らかの形でこの問題に対処してくるのではないかと思ってます

コメント