WD40EFRX-RT2をTS-873に入れてみた記録

最初に

QNAP TS-873-4G

メモリを64GB化済

Amazon | QNAP(キューナップ) TS-873 クアッドコア2.1 GHz CPU 4GBメモリ 8ベイ DTCP-IP/DLNA対応

https://amzn.to/34uq7oC

WD WD40EFRX-RT2

Amazon | WD HDD 内蔵ハードディスク 3.5インチ 4TB WD Red NAS用 WD40EFRX-RT2 5400rpm 3年保証

https://amzn.to/2q3yQ2t

8台検証したST1000DM010は7200rpmのHDDだったので

5400rpmのHDDで検証する為、WD40EFRX-RT2を使用します

こちらは手元に4台しかなかったので4台までの検証を行います

IntelliParkを無効化

WDのHDDを買ってまずすることはもちろんIntelliParkを無効化です

NASに突っ込む前に余ってるPCにWD40EFRX-RT2を接続して

Arch LinuxのUSBブートで起動

idle3-toolsをインストール

# pacman -Syy idle3-tools

無効化したいWD40EFRX-RT2のデバイス名確認

# fdisk -l

現在のIntelliPark設定状態を確認(sdaの部分をfdiskの結果に合わせる)

# idle3ctl -g /dev/sda

Idle3 timer set to 138 (0x8a)

IntelliParkを無効化する

# idle3ctl -d /dev/sda

Idle3 timer disabled

シャットダウンで終了

# shutdown -h now

この時点で設定されていますが

念のため確認したい場合は再度PCを起動して設定状態を確認します

WD40EFRX-RT2のIntelliPark設定値は初期値だと300秒

# idle3ctl -g /dev/sda

Idle3 timer set to 138 (0x8a)

ちなみにWD Blueの場合は初期値が8秒

Idle3 timer set to 80 (0x50)

WD Redの場合はBlueより長めに設定されているので

Load_Cycle_Countカウントはかなり減るとは思うが

ここを調整してきてる辺りWDもわざと嫌がらせしてるんじゃないのかと思いつつ

そもそも不要な機能なので無効化しました

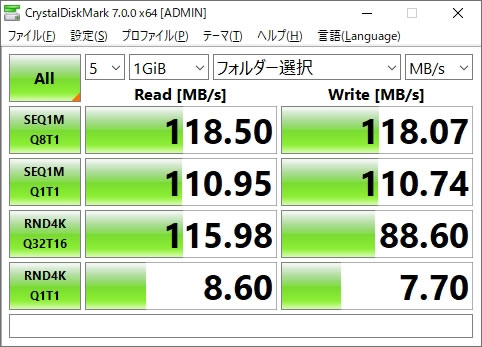

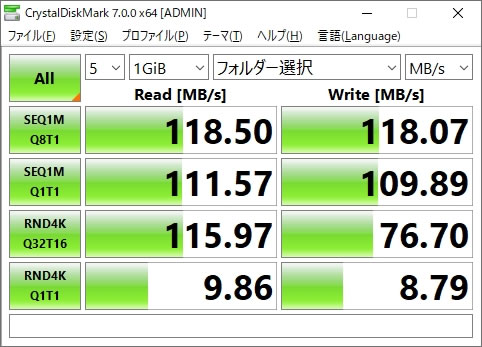

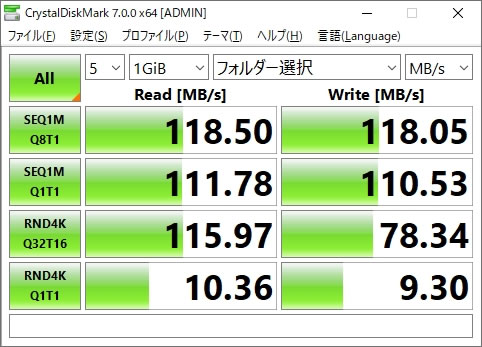

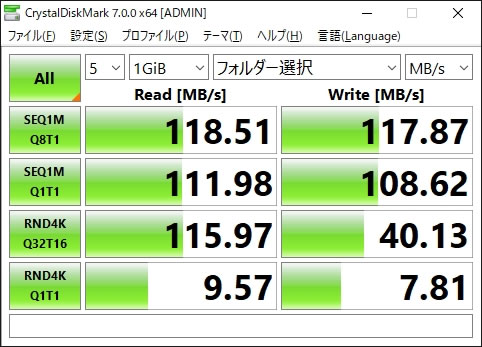

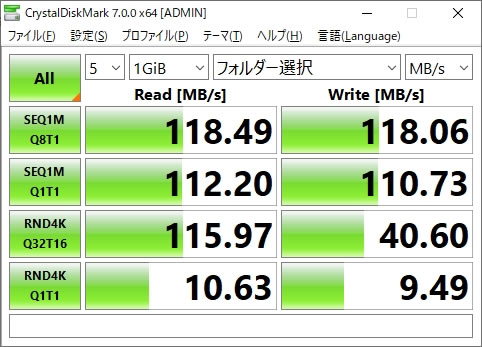

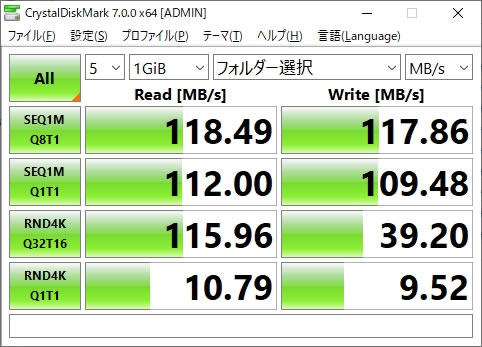

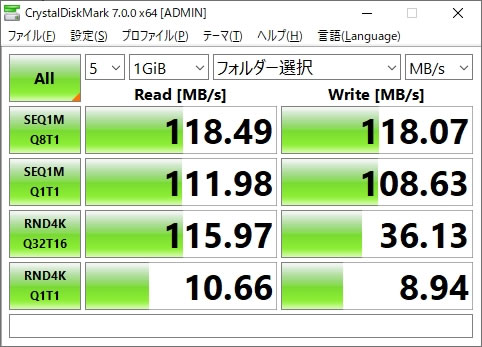

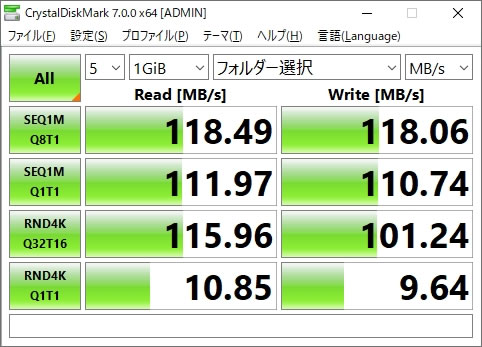

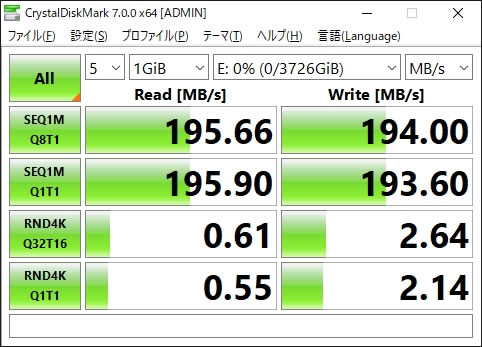

WD40EFRX-RT2単体で計測

NASではなくPCへ接続して直接計測

TS-873に入れて計測

QTSのバージョンは4.4.1.1117

QTS上でのWD40EFRX-RT2の実認識容量は3.64TB(4TB)

システムボリュームは別のディスクへ既に作成済

NASローカル計測の計測方法については以前の記事と同じですので

そちらをご覧ください

TS-873でのローカル速度計測 | fefcc.net

https://fefcc.net/archives/886

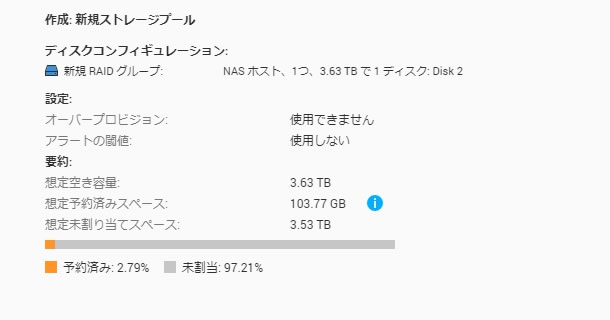

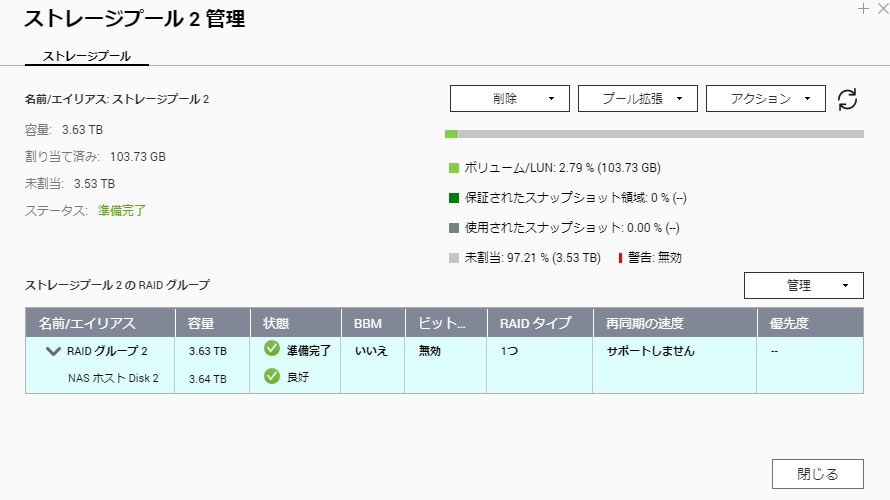

HDD1台 RAIDなし

ストレージプール作成の想定容量

想定空き容量:3.63TB

想定予約済みスペース:103.77GB

想定未割り当てスペース:3.53TB

実際に構築した状態

空き容量:3.63TB

予約済みスペース:103.73GB

未割り当てスペース:3.53TB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV3_DATA/test/fio-cdm /share/CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 175.824| 171.037| | 512K | 52.054| 107.653| | 4K | 0.516| 1.849| |4KQD32| 1.776| 1.800|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV3_DATA/test/fio-cdm /share/CE_CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 168.727| 161.744| | 512K | 50.167| 96.613| | 4K | 0.524| 1.855| |4KQD32| 1.819| 1.854|

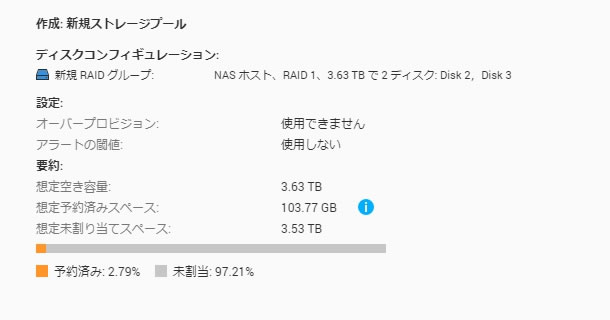

HDD2台 RAID1

ストレージプール作成の想定容量

想定空き容量:3.63TB

想定予約済みスペース:103.77GB

想定未割り当てスペース:3.53TB

実際に構築した状態

空き容量:3.63TB

予約済みスペース:103.73GB

未割り当てスペース:3.53TB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV3_DATA/test/fio-cdm /share/CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 169.762| 163.552| | 512K | 52.600| 96.060| | 4K | 0.527| 1.511| |4KQD32| 3.259| 1.768|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV3_DATA/test/fio-cdm /share/CE_CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 161.974| 148.406| | 512K | 51.148| 90.812| | 4K | 0.520| 1.497| |4KQD32| 3.276| 1.788|

HDD3台 RAID5

ストレージプール作成の想定容量

想定空き容量:7.26TB

想定予約済みスペース:140.94GB

想定未割り当てスペース:7.12TB

実際に構築した状態

空き容量:7.26TB

予約済みスペース:140.89GB

未割り当てスペース:7.12TB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV3_DATA/test/fio-cdm /share/CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 275.788| 154.193| | 512K | 54.376| 39.169| | 4K | 0.575| 0.636| |4KQD32| 4.795| 1.754|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV3_DATA/test/fio-cdm /share/CE_CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 264.189| 80.897| | 512K | 51.515| 35.444| | 4K | 0.564| 0.616| |4KQD32| 4.967| 1.703|

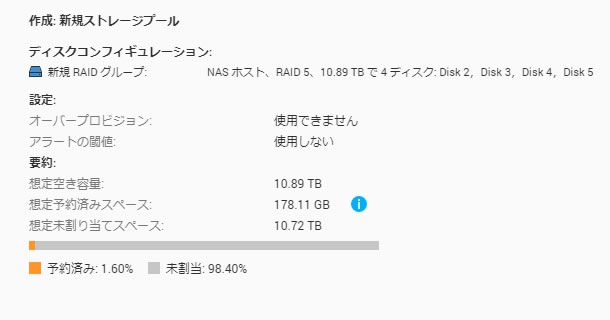

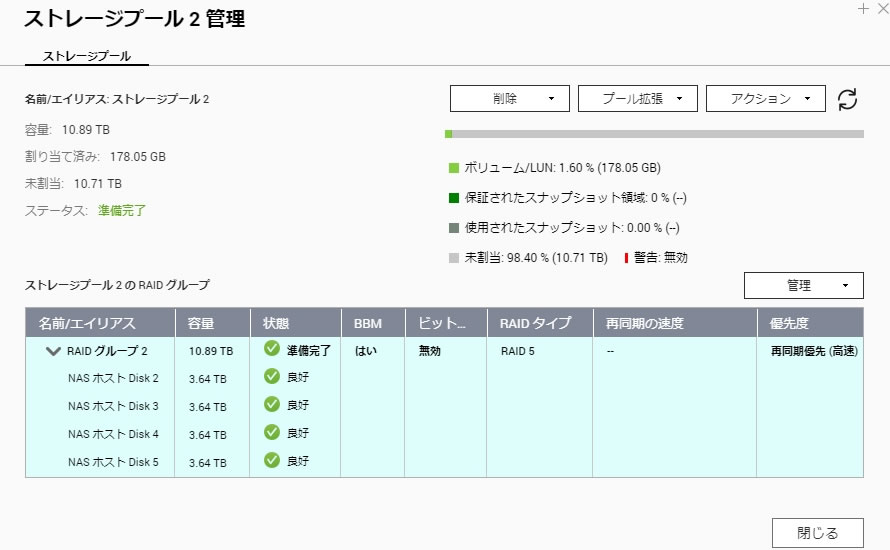

HDD4台 RAID5

ストレージプール作成の想定容量

想定空き容量:10.89TB

想定予約済みスペース:178.11GB

想定未割り当てスペース:10.72TB

実際に構築した状態

空き容量:10.89TB

予約済みスペース:178.05GB

未割り当てスペース:10.71TB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV3_DATA/test/fio-cdm /share/CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 205.457| 74.527| | 512K | 56.400| 34.311| | 4K | 0.613| 0.668| |4KQD32| 6.332| 1.594|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV3_DATA/test/fio-cdm /share/CE_CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 194.123| 61.380| | 512K | 53.501| 30.708| | 4K | 0.607| 0.651| |4KQD32| 6.254| 1.608|

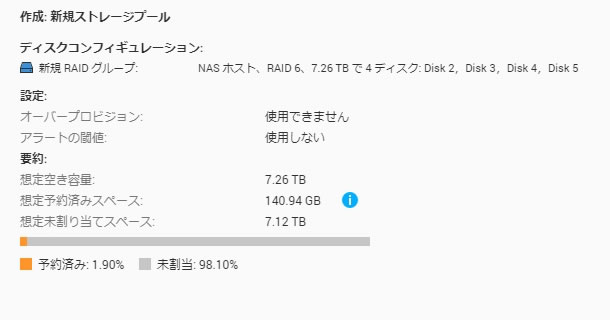

HDD4台 RAID6

ストレージプール作成の想定容量

想定空き容量:7.26TB

想定予約済みスペース:140.94GB

想定未割り当てスペース:7.12TB

実際に構築した状態

空き容量:7.26TB

予約済みスペース:140.89GB

未割り当てスペース:7.12TB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV3_DATA/test/fio-cdm /share/CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 201.614| 149.839| | 512K | 52.678| 36.516| | 4K | 0.583| 0.578| |4KQD32| 5.847| 1.604|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV3_DATA/test/fio-cdm /share/CE_CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 183.021| 77.559| | 512K | 52.117| 33.907| | 4K | 0.571| 0.571| |4KQD32| 5.859| 1.621|

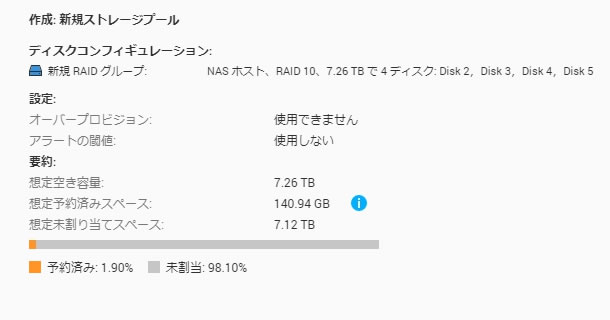

HDD4台 RAID10

ストレージプール作成の想定容量

想定空き容量:7.26TB

想定予約済みスペース:140.94GB

想定未割り当てスペース:7.12TB

実際に構築した状態

空き容量:7.26TB

予約済みスペース:140.89GB

未割り当てスペース:7.12TB

非暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CACHEDEV3_DATA/test/fio-cdm /share/CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 344.434| 308.248| | 512K | 54.751| 166.721| | 4K | 0.566| 2.529| |4KQD32| 5.720| 3.406|

暗号化シックボリューム

CrystalDiskMark 7.0.0fを使ってGbE経由で計測した結果

ローカル計測結果

[~] # /share/CE_CACHEDEV3_DATA/test/fio-cdm /share/CE_CACHEDEV3_DATA/test | | Read(MB/s)|Write(MB/s)| |------|-----------|-----------| | Seq | 342.475| 217.826| | 512K | 54.877| 138.006| | 4K | 0.563| 2.527| |4KQD32| 5.727| 3.464|

まとめ

今回もWindowsからの計測はGbE上限値なのであまり意味はないですが

SSD記事と同様に記録用として丸ごと掲載しました

ローカル計測結果については

ST1000DM010より高速になってたり逆に数値落ちすぎじゃない?と思う場面があり

自分でみても裏で何か動いてるのか?と確認したぐらい謎でしたが

ちゃんと前回同様の条件として10回10秒間隔で計測したので

結果は結果としてそのまま掲載しました

ST1000DM010でのローカル計測記事でも書きましたが

fio-cdm計測は50前後の誤差が平気で発生してしまうので

そのつもりで参考にしてください

LAN経由だとよっぽどの一気に大容量を流し込まなければ

メモリキャッシュが機能して転送速度は安定するので

実用上ではあまり気にすることはないと思います

コメント